Das lineare Regressionsmodell, in seiner allgemeinen Form mit \(P\) Kovariaten, basiert auf folgenden Modellannahmen:

\[ Y_{i} = \beta_0 + \beta_1 \cdot x_{1i} + \beta_2 \cdot x_{2i} + \ldots + \beta_P \cdot x_{Pi} + \epsilon_i \qquad (i=1,\ldots ,n) \]

- \(\epsilon_{1}, \ldots, \epsilon_{n}\) sind normalverteilt (Die Normalverteilungsannahme wird benötigt, um Standard-Tests im Regressionsmodell durchführen zu können, für die Schätzung an sich ist sie nicht erforderlich) mit folgendem Mittelwert und Varianz:

$$E(\epsilon_{i}) = 0 $$

$$V(\epsilon_{i}) = \sigma^{2}$$

- \(\epsilon_{1}, \ldots, \epsilon_{n}\) sind unabhängig,

- \( \epsilon_{i}\) und \(X_{i,p} \:(p=1, \ldots, P) \) sind unkorreliert

Etwas weniger technisch lassen sich diese Annahmen wie folgt zusammenfassen:

| Annahme | Was bedeutet das wirklich? | Wann wird die Annahme wahrscheinlich verletzt? | Warum is das ein Problem? |

|---|---|---|---|

| Linearität | Lineare Abhängigkeit zwischen den erklärenden Variablen und der Zielvariable | Schätzwerte der Koeffizienten sind verzerrt | |

| Erwartungswert der Störgröße gleich Null | Die Beobachtungen der abhängigen Variable y weichen nicht systematisch von der Regressionsgeraden ab, sondern streuen zufällig darum. | Klar voneinander abgegrenzte Untergruppen in den Daten können dieses Problem verursachen (Männer vs Frauen). | Verzerrung der Schätzung von \(\beta_{0}\) |

Unabhängigkeit | verschiedene Beobachtungseinheiten beinflussen sich nicht gegenseitig | Abhängigkeit der Beobachtungen tritt häufig in der Zeitreihenanalyse auf (Temperaturen in Sommer vs. Winter) | Verzerrung bei der Ermittlung der Standardfehler und Konfidenzintervalle; daraus folgt Ineffizienz der Schätzung |

| Die Varianz des Fehlerterms darf nicht von unabhängigen Variablen oder der Beobachtungsreihenfolge abhängig sein | Klar voneinander abgegrenzte Untergruppen in den Daten können dieses Problem verursachen (Männer vs Frauen). | Konfidenzintervalle und Hypothesentests sind nicht verlässlich, da die Standardfehler der Regressionskoeffizienten verfälscht berechnet werden. Die geschätzten Koeffizienten sind nicht mehr BLUE (nicht mehr effizient). | |

Residuen normalverteilt | Die Fehlerterme folgen eine Normalverteilung | Das kann immer passieren | Konfidenzintervalle und Hypothesentests sind ungültig |

| Die unabhängigen Variablen dürfen untereinander nicht zu stark korrelieren. | Es liegt vor, wenn zwei oder mehr erklärende Variablen eine starke Korrelation untereinander aufweisen (z.B. Brutto- und Nettoeinkommen) | Schätzungen der Regressionsparameter werden unzuverlässig; Redundanz in den Daten durch Überschneidung der Streuung in den unabhängigen Variablen => weniger Aussagekraft durch das Modell |

Die Gültigkeit der Annahmen sollte geprüft werden.

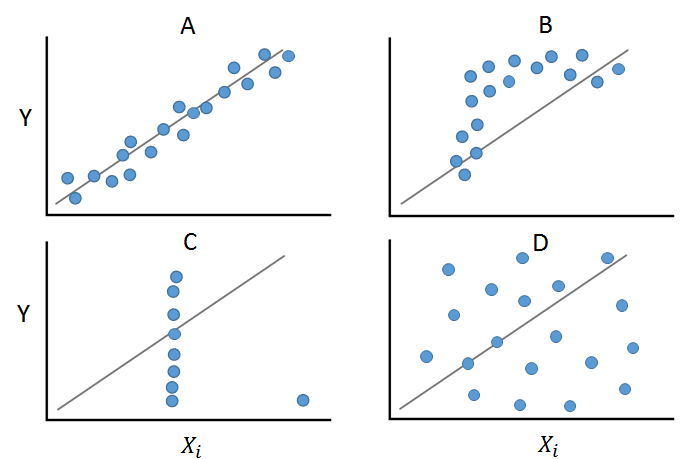

Zunächst sollte untersucht werden, ob zwischen den metrischen unabhängigen Variablen und der abhängigen Variable überhaupt ein linearer Zusammenhang besteht. Dies lässt sich graphisch anhand von Streudiagrammen überprüfen.

Wenn die Beziehung zwischen zwei Variablen nichtlinear ist oder wenn Ausreißer vorhanden sind, schätzt der Korrelationskoeffizient die Stärke der Beziehung falsch. Das Plotten der Daten vor dem Berechnen eines Korrelationskoeffizienten ermöglicht, die lineare Beziehung zu überprüfen und mögliche Ausreißer zu identifizieren. Der Fall (A) zeigt starke positive Korrelation (= steigende Gerade). Fall (B) zeigt einen unpassenden, da nichtlinearen Zusammenhang. Fall (C) veranschaulicht einen Fall, in dem es eine sehr starke lineare Beziehung gibt, mit der Ausnahme einer Beobachtung. Diese hat jedoch einen großen Einfluss auf den Steigungsparameter der Geraden. (D) zeigt ein Beispiel in dem keine Korrelation zwischen den Variablen zu beobachten ist.

Eine andere Möglichkeit ist die sogenannte Partial Residual Plot zu benutzen. Hierbei wird das Verhältnis zwischen einer unabhängigen und der abhängigen Variable unter der Voraussetzung abgebildet, dass auch andere Kovariate im Modell enthalten sind. Ein linearer Zusammenhang wird auf dem Schaubild in Form einer roten Geraden dargestellt. Die grüne Gerade repräsentiert die Modellierung des Zusammenhangs durch sogenannte Splines. Sollte der Zusammenhang nicht linear sein, so können eventuell die im weiteren vorgestellten Transformationen dazu benutzt werden, den Zusammenhang zu linearisieren.

Weiterhin wird vorausgesetzt, dass die Residuen unabhängig sind und eine konstante Varianz aufweisen (\( V(\epsilon_{i}) = \sigma^{2}\)," Homoskedastizität"). Dies kann überprüft werden, indem die geschätzten Werte der abhängigen Variablen in einem Streudiagramm gegen die Residuen gezeichnet werden (sog. Residuenplot).

Die Punkte in dem Diagramm sollten unsystematisch streuen. Das Auftreten einer Trichterform deutet auf eine Verletzung der Annahme konstanter Varianzen („Heteroskedastizität“) hin. Ist eine Systematik in den Punkten erkennbar, so ist diese meist auf eine Verletzung der Unabhängigkeitsannahme zurückzuführen. In Dem Fall (A) verteilen sich die Residuen ungefähr in einem gleichbleibend dickem horzontalen Band. Hier sind weder Abhängigkeiten, noch Heteroskedastizität erkennbar. Formen die Punkte einen „Trichter“ oder eine „Raute“, ist dies ein Hinweis auf eine Verletzung der Annahme gleicher Varianzen (Fall B, C, F). Fälle wie (D) und (E) zeigen einen quadratischen/ logarithmischen Zusammenhang. Die Residuen streuen also nicht zufällig, sondern es ist eine klare Systematik erkennbar. Oft hängt diese Annahmenverletzung mit Problemen der Nichtlinearität (zwischen abhängiger und unabhängiger Variable) zusammen.

Beobachtungen mit großem Einfluss auf die Parameterschätzer lassen sich auch in dieser Art von Streudiagramm erkennen.

Damit man den F-Test und die t-Tests für die Parameter sinnvoll interpretieren kann, müssen die Residuen normalverteilt sein. Um dies graphisch zu prüfen, kann das Histogramm der standardisierten Residuen verwendet werden.Das Histogramm wird oft zusammen mit der Dichte der Standardnormalverteilung dargestellt. Die Form des Histogramms sollte möglichst der der Kurve entsprechen. Das vorliegende Histogramm zeigt, dass die Verteilung der Residuen im Vergleich zur Normalverteilung eher rechtsschief ist.

Eine weitere Möglichkeit zur Überprüfung der Normalverteilungsannahme der geschätzten Residuen sind Quantil-Quantil (Q-Q) Plots. Hierbei werden die Quantile der Fehlerterme gegen die theoretischen Quantile der Standardnormalverteilung abgetragen. Dieser Q-Q Plot weißt auf starke Abweichungen zwischen den Verteilungen hin. Die Punkte in kleinen und hohen Quantilen liegen über der eingezeichneten Geraden. Liegen alle Punkte auf der Geraden, sind die Verteilungen identisch. Der vorliegende Q-Q Plot spricht für eine linksschiefe Verteilung (positive Schiefe). Neben der graphischen Annahmenprüfung können auch Tests auf Normalverteilung wie der Shapiro-Wilk-Test oder der Kolmogorow-Smirnov-Test durchgeführt werden. Falls die Normalverteilungsannahme nicht erfüllt sein sollte, gibt es die Möglichkeit Variablentransformationen durchzuführen. Ein klassisches Beispiel dafür ist die Variable Einkommen. Dieses ist häufig nicht normalverteilt, das durch Logarithmierung transformierte Einkommen jedoch schon.

Graph (A) kann als "idealer" Q-Q Plot gesehen werden, wobei die Punkte sehr nahe an oder sogar auf der Gerade liegen. Im Fall (B) hat die Verteilung der Residuen dünnere Enden als die Normalverteilung. Der Graph (C) zeigt das typische Verhalten einer Verteilung mit dickeren Enden als bei einer Normalverteilung (S-Grafik). Grafiken (D) und (E) zeigen eine Muster, mit positiven und negativen Bias.

.